Google Antigravity công cụ AI thay đổi quy trình làm việc

Tóm tắt nhanh

Google Antigravity IDE là công cụ AI agent thế hệ mới từ Google, hoạt động bất đồng bộ để tự động hóa quy trình lập trình, điều phối nhiều agent chạy song song và tương tác trực tiếp với trình duyệt web giúp tối ưu hóa hiệu suất làm việc vượt trội.

Bạn gõ một câu lệnh, AI tự lên kế hoạch, mở terminal, viết code, mở trình duyệt web kiểm tra rồi báo lại kết quả, Antigravity làm tất cả trong khi bạn đang uống cà phê. Đó không phải viễn cảnh tương lai, đó là cách Google Antigravity hoạt động và nó vừa thay đổi hoàn toàn cách mình tiếp cận việc xây dựng sản phẩm và quy trình tự động.

Google Antigravity là gì?

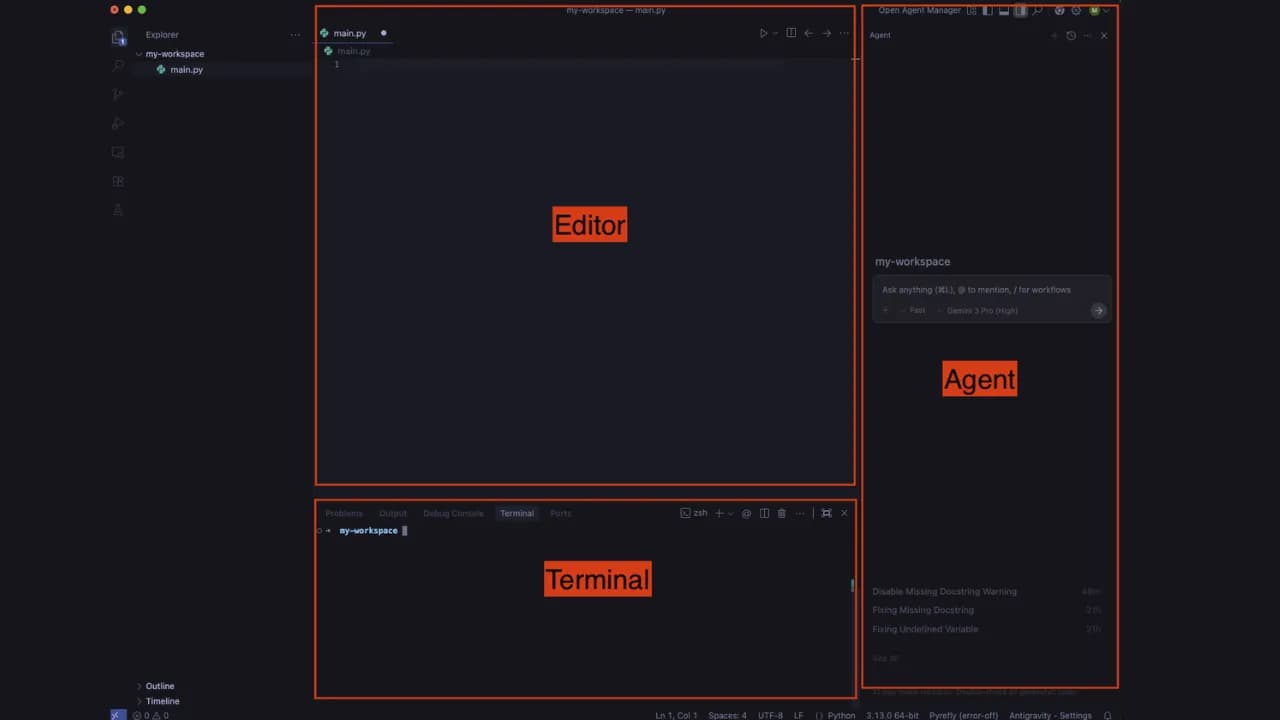

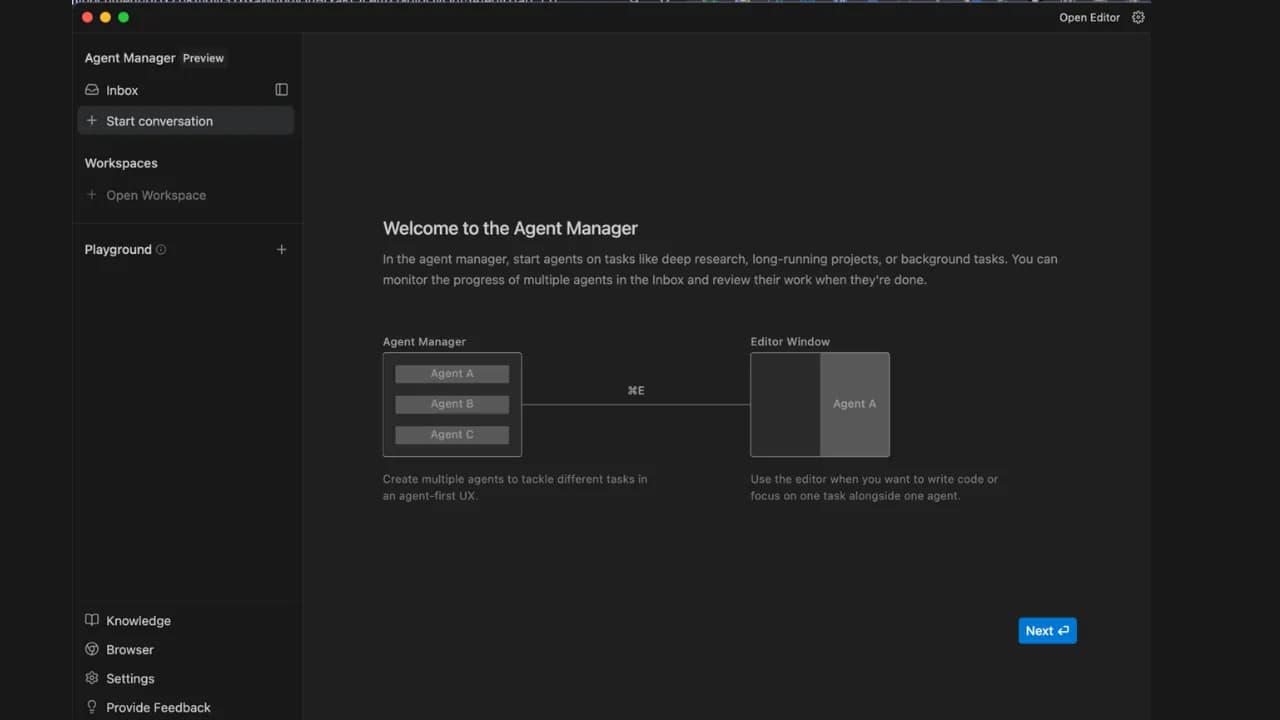

Antigravity là IDE thế hệ mới do Google ra mắt cuối tháng 11 năm 2025 cùng lúc với Gemini 3, được xây dựng trên nền VS Code nhưng với kiến trúc hoàn toàn khác: thay vì AI ngồi ở sidebar gợi ý từng dòng code, AI trong Antigravity làm việc như một agent thực sự một khi đã được cấp quyền thì chúng ta có thể giao task và Antigravity tự hoàn thành task đó để cho ra kết quả rất giống với Manus và Flowith nhưng ở đây Antigravity thiên về màn hình làm việc với code hơn.

Điểm khác biệt lớn nhất so với Cursor hay GitHub Copilot là Antigravity không hỏi bạn từng bước mà hoạt động bất đồng bộ đó là khi bạn giao task, agent chạy ngầm trong nền trong khi bạn làm việc khác rồi quay lại xem kết quả. Antigravity hoàn thành một feature Next.js + Supabase điển hình trong 42 giây so với 68 giây của Cursor, và độ chính xác khi refactor đạt 94% so với 78% của Cursor.

Antigravity đã có phần mềm hỗ trợ macOS, Windows và Linux nên mọi người không lo về vấn dề phần mềm mà chỉ nên lo về chi phí gọi API. Ngoài sử dụng Gemini 3 và Gemini 3 pro mặc định, Antigravity còn hỗ trợ Claude Sonnet, Claude Opus và GPT-OSS thật tốt khi không bị khoá vào nền tảng của Google khi mà Claude Sonnet, Claude Opus đang dẫn đầu thị trường.

Các tính năng tiêu biểu của Antigravity IDE

Chỉnh sửa trực tiếp với sự hỗ trợ của AI

Với giao diện quen thuộc như VS Code, nơi các lập trình viên có thể chỉnh sửa code tay hoặc nhờ AI hỗ trợ từng đoạn cụ thể. Phù hợp khi bạn muốn kiểm soát từng bước hoặc xử lý những đoạn code cần sự chú ý cao.Điều phối agent chạy song song

Đây là điểm khác biệt thực sự của Antigravity thực sự với "mission control" bạn không cần viết code ở đây mà điều phối nhiều agent chạy song song. Ví dụ một agent đang refactor module A, agent khác đang viết test cho module B, agent thứ ba đang debug lỗi UI trên trình duyệt web. Bạn theo dõi tiến độ, để lại comment như trên Google Docs và agent tự điều chỉnh mà không cần dừng lại chờ.

Truy cập và điều khiển trình duyệt web

Đây là tính năng mình thấy ấn tượng nhất khi mới dùng khi mà Antigravity có thể mở trình duyệt web như Chrome, Firefox,... khi được cấp quyền từ đó nó có thể điều hướng trang web, điền form và kiểm tra giao diện hoàn toàn tự động. Tuy nhiên cần lưu ý rằng Antigravity hoạt động giống hệt như Puppeteer nên chỉ tương tác được với các tác vụ trên trình duyệt và khi cần có thể xử lý ảnh và chụp ảnh màn hình và tất nhiên chưa hoạt động được với những trang web đã cài đặt chặn bot truy cập.Logic của Antigravity rất rõ ràng

Đây là tính năng mình thích nhất khi làm việc với Antigravity đó là thay vì đổ raw code ra màn hình, agent tạo ra các deliverable có thể đọc được như task list, implementation plan, screenshot màn hình app đang chạy để bạn kiểm tra logic của agent cả trước và sau khi hoàn thành task, điều này giúp bạn luôn nắm được agent đang làm gì để đánh giá.Antigravity đang được dùng để làm những gì trong thực tế?

Nhiều người nghe đến Antigravity và nghĩ ngay đây là công cụ dành riêng cho lập trình viên chuyên nghiệp. Thực tế thì không phải vậy vì phạm vi ứng dụng rộng hơn nhiều so với vẻ ngoài kỹ thuật của nó.

Xây dựng và triển khai website

Đây là use case phổ biến nhất. Bạn mô tả trang web muốn xây — stack kỹ thuật, tính năng, phong cách thiết kế — agent tự viết code, tự kiểm tra trên browser và tự sửa lỗi. Kết hợp với Google Stitch qua MCP, bạn có thể đi từ thiết kế UI đến sản phẩm chạy thực sự mà không cần chuyển qua lại giữa nhiều công cụ.Ví dụ prompt dùng trong Antigravity: "Xây cho mình một landing page bằng Next.js và Tailwind CSS cho sản phẩm SaaS quản lý công việc nhóm. Có section hero, bảng giá 3 gói và form đăng ký email. Deploy lên localhost và chụp screenshot kết quả."

Tự động hóa quy trình lặp lại

Một trong những điểm mạnh thực tế nhất. Bạn có thể nhờ Antigravity tự động crawl dữ liệu từ nhiều nguồn, tổng hợp và gửi báo cáo theo lịch, hoặc tự động điền form và thực hiện các thao tác lặp đi lặp lại trên trình duyệt — những việc trước đây cần viết script riêng hoặc dùng công cụ automation phức tạp.Ví dụ prompt: "Mỗi sáng 8 giờ, vào trang thống kê của website mình tại [URL], lấy số liệu pageview và top 5 bài viết và xem thông tin 5 bài viết của trang fanpage Facebook của mình ở trang [URL], tổng hợp thành file markdown và lưu vào thư mục /reports/daily."

Xây dựng hệ thống AI agent

Đây là use case mà Antigravity thực sự vượt trội so với các công cụ khác. Thay vì chỉ viết một đoạn code đơn lẻ, bạn có thể mô tả cả một pipeline — ví dụ "tạo hệ thống phân tích review sản phẩm từ nhiều nguồn, phân loại sentiment và tự động tag vào database" — rồi để Antigravity thiết kế kiến trúc agent, phân chia nhiệm vụ và triển khai từng bước.Ví dụ prompt: "Tạo một hệ thống gồm 3 agent: agent 1 crawl review sản phẩm từ Shopee và Lazada mỗi ngày, agent 2 phân tích sentiment và phân loại theo chủ đề, agent 3 tổng hợp thành báo cáo tuần và lưu vào Google Sheets."

Refactor và cải thiện codebase có sẵn

Nếu bạn có một dự án cũ cần nâng cấp, Antigravity đặc biệt hữu ích khi cần refactor quy mô lớn có thể thay đổi toàn bộ cấu trúc file, cập nhật dependencies, viết test coverage cho code chưa có test. Agent đọc toàn bộ codebase, hiểu ngữ cảnh và thực hiện thay đổi nhất quán trên nhiều file cùng lúc thay vì sửa từng chỗ một.Ví dụ prompt: "Đọc toàn bộ codebase trong thư mục /src, đóng vai chuyên gia bảo mật xem có dính lỗi SQL injection, các lỗ hổng owasp không đề xuất chỉnh sửa sao cho vẫn giữ nguyên logic và đảm bảo không có lỗi sau khi refactor."

Nghiên cứu và tổng hợp thông tin từ web

Vì Antigravity có thể điều khiển trình duyệt, bạn có thể dùng nó để tự động truy cập nhiều trang web, trích xuất thông tin theo cấu trúc bạn định sẵn và tổng hợp lại thành báo cáo hoặc database — phù hợp với các tác vụ research cần thu thập dữ liệu từ nhiều nguồn mà làm thủ công sẽ rất tốn thời gian.Ví dụ prompt: "Vào 10 trang web tin tức AI này [danh sách URL] và các trang fanpage [danh sách URL] tìm các bài đăng trong 7 ngày qua, trích xuất tiêu đề, tóm tắt 2 câu và link gốc, lưu vào file CSV theo thứ tự mới nhất trước."

Các câu hỏi thường gặp khi sử dụng Antigravity

Antigravity có miễn phí không?

Có cả gói miễn phí và trả phí.- Gói miễn phí có quota reset theo tuần với rate limit hạn chế, đủ để thử nghiệm và làm project nhỏ.

- Gói Pro/Ultra có quota reset mỗi 5 giờ và được ưu tiên cao nhất rất phù hợp nếu bạn dùng Antigravity hàng ngày cho công việc thực tế.

Antigravity có làm được việc với file Word, Excel, PDF không?

Antigravity cài Puppeteer nên hoạt động chủ yếu qua trình duyệt web và chưa thể tác động trực tiếp vào các loại file như Word, Excel hay PDF. Nếu cần xử lý những file này, bạn phải thêm vào workflow và mention trong phần cấu hình để agent biết cách tiếp cận đúng.

AI không phản hồi hoặc bị treo phải làm gì?

Đây là lỗi khá phổ biến, đặc biệt vào giờ cao điểm khi nhiều người dùng đồng thời. Trong hầu hết trường hợp, chỉ cần restart lại Antigravity là được hoàn toàn không cần lo mất dữ liệu hay phải thiết lập lại từ đầu. Ngoài ra, nên dùng git và commit thường xuyên trước khi giao task lớn để tránh mất code nếu agent bỏ dở giữa chừng.

Antigravity thực sự là công cụ quá mạnh mẽ vì sao chúng ta không thử ngay. Người dùng có thể tải về tại antigravity.google/download và bắt đầu với một project nhỏ — không phải để thử tính năng mà để hiểu tư duy làm việc mới này trước khi đưa vào dự án thực tế.